گزارش مهر از نتیجه علم بدون اخلاق؛

چگونه پیشرفتهای علمی می تواند به نابودی بشریت بینجامد

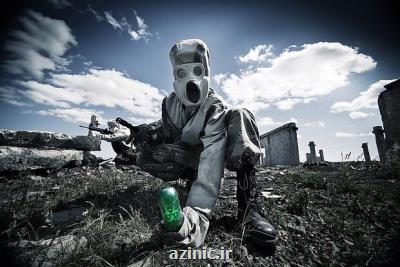

به گزارش آزینیک دستاوردهای بشر در علم و فناوری به شمشیری دو سویه تبدیل گشته اند که هرچند به بهبود زندگی بشر کمک می کنند اما امکان دارد به دشمنان اصلی حیات انسان در کره خاکی تبدیل شوند.

به گزارش آزینیک به نقل از مهر، علم و فناوری جامعه انسانی و محیط اطراف آنرا به طرق مختلف تحت تاثیر قرار داده اند. در بعضی جوامع، علم و فناوری به توسعه اقتصادی منجر شده اند و تأثیرات مثبتی در زندگی انسان و محیط اش داشته اند. با این وجود چالش های جدی هم بوجود آورده اند که تأثیراتی منفی یا ناخواسته ای هم در بر داشته است.

مقام معظم رهبری هم اخیرا در سخنرانی خود در روز مبعث به جنبه های منفی پیشرفت های علم و فناوری اشاره کردند و اظهار داشتند: "حرص و طمع، پول، تبعیض، استفاده از علم و فناوری برای کشتار انسان ها، غارت کشورهای ضعیف و ابتذال شدید اخلاقی و هرج و مرج جنسی، شاخص ها و پایه های اصلی تمدن غربی است که در واقع شکل مدرن شده همان جاهلیت قبل از اسلام است."

در این نوشتار به بهانه فرمایشات اخیر رهبر انقلاب به جنبه های منفی استفاده از علم و فناوری و هشدارهای در ارتباط با آن پرداخته شده است.

تاکنون نظریه هایی هم در تأیید این امر عرضه شده و فیلسوفان و محققان مختلف درباره خطرات دستاوردهای نوین بشر اخطار داده اند.

۳۰۸۰ کلاهک هسته ای در جهان

یکی از دستاوردهای مخرب پیشرفت های علم و فناوری توسعه اسلحه های کشتار جمعی است. اسلحه کشتار جمعی امکان دارد هسته ای، رادیولوژیکی، شیمیایی، بیولوژیکی یا هر سلاح دیگری باشد که قادر به از بین بردن انسان ها و ایجاد صدمات زیادی به گروهی از افراد است. همینطور چنین سلاح هایی به سازه های ساخت انسان (مانند ساختمان ها)، سازه های طبیعی (مثلاً کوه ها) و در کل به موجودات کره زمین صدمه می رساند.

در توضیح سلاح های کشتار جمعی میتوان آنها را به این صورت تعریف کرد: جنگ افزار رادیولوژیکی هر شکلی از اسلحه بشمار می رود که شامل مسمومیت عمدی تشعشع یا آلودگی یک منطقه به منابع رادیولوژیکی را به وجود بیاورد. کشورهای گوناگونی نسبت به برنامه تسلیحات رادیولوژیکی تمایل دارند، اما فقط برخی از آنها ساخت چنین جنگ افزاری را دنبال می کنند.

سلاح شیمیایی (CW) یک جنگ افزار تخصصی است که از مواد شیمیایی برای کشتن یا صدمه به انسان ایجاد می شود. به قول سازمان منع سلاح های شیمیایی (OPCW)، «اصطلاح سلاح شیمیایی امکان دارد به هر ماده شیمیایی سمی یا پیش ساز آنکه می تواند سبب مرگ، جراحت، ناتوانی موقت یا تحریک حسی از راه عمل شیمیایی شود، باشد. »

سلاح یا عامل بیولوژیکی در کل یک باکتری، ویروس، تک یاخته، انگل، قارچ، ماده شیمیایی یا سم است که می تواند به صورت هدفمند بعنوان یک سلاح در بیوتروریسم استفاده گردد. علاوه بر این پاتوژن های زنده یا درحال تکثیر، سموم و بیوتوکسین ها هم جزو عوامل بیولوژیکی به حساب می آیند. تابحال بیشتر از ۱۲۰۰ نوع عامل بیولوژیکی با قابلیت تبدیل به اسلحه توصیف و مطالعه شده اند.

عامل های بیولوژیکی به طرق مختلف روی سلامت انسان تاثیر منفی ایجاد می کنند. این تأثیرات شامل واکنش های حساسیتی معتدل تا شرایط پزشکی جدی همچون جراحات، معلولیت مادام العمر و حتی مرگ را به دنبال دارند.

اما در این میان تسلیحات هسته ای پرخطرتر هستند چونکه قدرت تخریب بسیار بیشتری دارند. به صورت دقیق تر اسلحه هسته ای یک دستگاه انفجاری است که قدرت ویرانگر همجوشی هسته ای را دارد. تسلیحات هسته ای هم بمب اتمی، بمب هسته ای و کلاهک هسته ای هستند.

در حال حاضر طبق اطلاعات وبسایت انجمن کنترل تسلیحات(Arms Control Association)که در ژانویه ۲۰۲۲ میلادی آپدیت شده، تخمین زده می شود در جهان حدود ۱۳۰۸۰ کلاهک هسته ای وجود دارد.

هرچند تعداد این کلاهک ها در روسیه و آمریکا نسبت به زمان جنگ سرد کاهش یافته، اما باید اشاره نمود طی ۳۰ تا ۴۰ سال گذشته تعداد کشورهای بیشتری به این نوع تسلیحات دست یافته اند. هم اکنون روسیه بیشترین تعداد کلاهک هسته ای (۶۲۵۷ عدد) را در اختیار دارد. بعد از روسیه، آمریکا با ۵۵۵۰ کلاهک، چین (۳۵۰)، فرانسه (۲۹۰)، انگلیس (۲۲۵)، پاکستان (۱۶۵)، هند (۱۵۶)، رژیم صهیونیستی (۹۰) و کره شمالی (حدود ۴۰ تا ۵۰ عدد) بیشترین تعداد کلاهک های هسته ای در جهان را در اختیار دارند.

نانو ماشین هایی با قابلیت از بین بردن انسان در جهان

نیک بوستروم فیلسوف، متعقد است که هوش مصنوعی در آینده به انقراض انسان منجر می شود. وی در کتاب پرفروش خود به نام ابر هوش: مسیرها، خطرها و استراتژی ها تصویری تیره و تار از آینده ای رسم می کند که در آن محققان یک ماشین با قابلیت ارتقای دائمی می سازند.

این ماشین به تدریج می آموزد تا از تراکنش های آنلاین درآمدزایی کند و کالا و سرویس در دنیای واقعی بخرد. از طرفی این ماشین با استفاده از دی ان ای که سفارش داده، نانوسیستم های ساده ای می سازد که به سیستم های پیچیده تر تبدیل می شوند و در نتیجه قدرت بیشتری برای تغییر جهان اطراف خود می یابند.

بوسترم دراین باره می نویسد: حالا تصور کنید هوش مصنوعی گرفتار این شک شود که انسان در برنامه هایش تداخل بوجود می آورد. امکان دارد اسلحه های کوچکی بسازد و آنها را به صورت مخفیانه در جهان توزیع کند. امکان دارد کارخانه های نانوی کوچکی در سرتاسر جهان و به صورت همزمان در یک بازه زمانی از پیش تعیین شده، یک گاز تخریب اعصاب تولید کنند یا ربات هایی توسعه دهند که مانند پشه ها هدف خویش را دنبال می کنند.

بوستروم و عده ای از فلاسفه معتقدند چنین سناریوهایی فراتر از داستان های علمی تخیلی هستند. آنها درباره پیشرفت های فناورانه ای که خطرات وجود به همراه دارد و امکان دارد به از بین رفتن بشریت یا تمدن به شکل شناخته شده آن منجر شود و همینطور راه هایی برای متوقف کردن آنها، مطالعه ای انجام داده اند.

هیو پرایس سرپرست مرکز خطر وجودی دانشگاه کمبریج(CSER) در اینباره می گوید: تصور کنید آنچه ما انجام می دهیم ایجاد یک تیم علمی برای مقابله با عواملی است که انسان را تهدید می کنند.

مطالعه خطرهای وجود راه مقابله با جنبه های منفی فناوری

مطالعه خطرهای وجودی هنوز حوزه نوپا و کوچکی است که در سال ۲۰۱۸ میلادی تعداد اندکی افراد در ۳ مرکز درباره آن مشغول فعالیت بودند چونکه هنوز هیچکس متقاعد نشده این حوزه جدی است. بیشتر سناریوهای به انتها رسیدن تمدن انسانی از حمله پاتوژن های ساخت انسان، لشکر نانوربات ها یا حتی ایده جهانی شبیه سازی شده، امکان دارد بسیار غریب به نظر برسد.

جویس تیت یکی از افرادی که روی چالش های قانونگذاری در علوم در انستیتو ایننوژن واقع در ادینبرا فعالیت می کند، در اینباره می گوید: الان تنها تهدید وجودی واقعی جنگ هسته ای است.

از سوی دیگر استیون پینکر روانشناس دانشگاه هاروارد خطرهای وجودی را یک دسته بندی بی استفاده می داند و اخطار می دهد این موارد امکان دارد انسان را از تهدیدهای پیش رو و قابل حل مانند تغییرات آب و هوایی و جنگ هسته ای دور کند. وی در کتابش می نویسد: ایجاد ترس و وحشت درباره فجایع احتمالی از آینده انسانیت محافظت نمی کند و حتی امکان دارد آنرا به خطر بیندازد.

بی توجهی به خطرات دستاوردهای علمی

با این وجود خیلی از طرفداران خطرهای وجودی پیشبینی می کنند با سرعت گرفتن پیشرفت های فناورانه و علمی، این حوزه اهمیت بیشتری می یابد. همانطور که بوستروم در تحقیق خود اشاره کرده تابحال تحقیقات زیادی در خطرات انقراض انسان انجام نشده است.

پرایس هم در اینباره می گوید: میتوان ادعا کرد در حوزه خطرات وجودی به بحث علم توجهی نشده است انسان همیشه با احتمال انقراض نابهنگام روبرو است. مثلا امکان دارد سیارکی مشابه آنچه دایناسورها را منقرض کرد، با زمین برخورد کند یا یک فوران آتشفشانی امکان دارد آسمان را برای سال ها تیره کند و انسان ها را به کام مرگ بفرستد. از طرفی بزودی تهدیدهایی در رشته های علمی مختلف ظاهر می شود. بوستروم در اینباره می گوید: در قرن جاری ما با پدیده جدیدی روبرو می شویم، به قدرت های جدیدی دست می یابیم تا جهان جدیدی بسازیم.

خطرات وجودی ریشه در علوم حیاتی دارد که در ظاهر بسیار ساده به نظر می رسند. بعنوان مثال پاتوژن ها نشان داده اند قادر به از میان بردن یک گونه هستند. بعنوان مثال ۴ پاندمی آنفلوانزا در قرن گذشته جهان را در برگرفته است. الان هم ویروس کرونا در سرتاسر جهان انتشار یافته است. محققان از الان مشغول مهندسی پاتوژن هایی هستند که احتمالاً خطرات بیشتری دارند. بعضی از کارشناسان هم در سال ۲۰۱۸ میلادی معتقد بودند ترورهای زیستی تا ۲۰۲۰ سالانه یک میلیون قربانی می گیرند.

ابر هوش تهدیدی اصلی برای انسان

این در حالی است که بوستروم اعتقاد دارد ویروس ها تهدید اصلی نیستند. بلکه هوش مصنوعی یک خطر واقعی بشمار می رود.

بسیاری از سناریوها مبتنی بر ماشین هایی هستند که از انسان ها باهوش تر هستند و در واقع ابر هوشمند به حساب می آیند. اگر چنین هوش مصنوعی ایجاد شود و خودمختار باشد، احتمالاً خطرناک می باشد.

هر چند تعداد زیادی از کارشناسان هوش مصنوعی درباره خطر هوشمندتر شدن ماشین ها از مبدعانشان نگران نیستند. اما جان تالین یکی از توسعه دهندگان نرم افزار اسکایپ در اینباره اعتقاد دارد هوش مصنوعی در صورتی خطرآفرین است که محیطی مرگبار برای انسان ها ایجاد نماید.

او می گوید: شرایطی را تصور کنید که در آن دمای هوا ۱۰۰ درجه سانتیگراد بالا می رود یا پایین می آید. در این وضعیت انسان ظرف چند دقیقه منقرض می شود.

البته برخی دیگر معتقدند مشکل اصلی آن نیست که هوش مصنوعی فناوری بدی است بلکه تکامل نیافته است. برای اجتناب از چنین روندی محققان کوشش می کنند ارزش های انسانی را به هوش مصنوعی بیاموزند. اما منتقدان ادعا می کنند چنین تلاش هایی موفقیت آمیز نیستند چونکه تهدیدهای آتی قابل پیشبینی نیستند.

اتوماسیون، ربات ها و ماشین یادگیری تهدیدهای تازه برای بشر

هنگامیکه از هوش مصنوعی سخن به میان می آید باید توجه داشت این فناوری تقریباً هر حوزه ای که به آن وارد شده را قدرتمندتر کرده است.

علاوه بر بیم آنکه ربات ها و اتوماسیون انسان ها را بیکار کنند، نیروی های فناوری پیشرفته بلاک چین، داده کلان، مهندسی ژنتیک، مهندسی زیستی و ماشین یادگیری هم قابلیت این را دارند که به تهدید تبدیل شوند.

از سوی دیگر شبکه های اجتماعی و جمع آوری داده های جمعیت ها هم با حقوق بشر تناقض دارند.

ماشین ها به صورت روزافزون ارزشهای انسانی را کم می کنند.

همین فناوری هایی که سبب بیکاری میلیاردها انسان می شود، نظارت و کنترل بر افراد را هم ساده تر می کند.

همچنین از طرفی وابستگی انسان به این فناوری ها و نسل های بعدی آنها یکی دیگر از تهدیدهای متوجه انسان است.

علاوه بر این موارد نباید بدافزارهایی را فراموش کرد که در سیستم های حیاتی اختلال ایجاد می کنند، غذاهایی که به صورت ژنتیکی هم دستکاری شده اند و انتشار اشعه های رادیواکتیو از دستگاه ها هم دیگر خطرات فناوری نوین برای انسان به شمار می آیند.

شبیه سازی انسان و دستکاری ژنتیکی مواد غذایی

یکی دیگر از خطرات در ارتباط با پیشرفت های فناوری به شبیه سازی انسان ها مربوط است. خیلی از محققان معتقدند این فناوری به درمان بیماری های مختلف و همینطور پیوند اعضا کمک می نماید.

اما نمی توان خطرات آنرا نادیده گرفت. این موارد شامل انواع نقایص در اندام های حیاتی مانند کبد، مغز و قلب است. نتایج دیگر شامل پیری زودرس و مشکلات سیستم ایمنی است. یکی دیگر از مشکلات احتمالی در ارتباط با سن نسبی کروموزوم های سلول شبیه سازی شده است.

دیگر تهدید بزرگی که از جانب فناوری خطراتی برای بشر دارد، دستکاری های ژنتیکی در گیاهان و تولید غذاهای تراریخته است. بزرگترین تهدید ناشی از غذاهای تراریخته این است که می توانند اثرات مضری بر بدن انسان داشته باشند. اعتقاد بر این است که مصرف این غذاهای دستکاری شده ژنتیکی می تواند سبب ایجاد بیماری هایی شود که در مقابل آنتی بیوتیک ها مصون هستند.

منبع: azinic.ir

این مطلب آزینیک را می پسندید؟

(0)

(0)

تازه ترین مطالب مرتبط آزینیک

نظرات خوانندگان آزینیک در مورد این مطلب

لطفا شما هم در مورد این مطلب نظر دهید